Caitlin Johnstone (Substack de la autora -Australia-), 28 de Abril de 2026

En los últimos días he visto tres casos distintos en los que se ha utilizado inteligencia artificial generativa para promover propaganda a favor de las agendas bélicas de Estados Unidos e Israel, y merece la pena prestarles atención.

En primer lugar, una empresa con sede en Israel llamada Generative AI for Good ha estado creando deepfakes de supuestas mujeres reales que afirman haber sido agredidas sexualmente por las fuerzas gubernamentales en Irán.

El Canario informa :

Una empresa israelí de inteligencia artificial, Generative AI for Good, afirma utilizar tecnologías deepfake con fines positivos. Por «positivos» parece entenderse la creación de vídeos deepfake para apoyar la guerra ilegal entre Estados Unidos e Israel contra Irán.

…

“Generative AI for Good afirma que utiliza la IA para ‘ayudar a los supervivientes a testificar de forma segura, con su propia voz y sin revelar su identidad’. Pero se ha demostrado que Israel y sus portavoces utilizaron falsas acusaciones de violaciones y otras atrocidades el 7 de octubre de 2023 para justificar el genocidio en Gaza.”

Según The Canary, Generative AI for Good cuenta con israelíes que tienen agendas muy evidentes, entre ellos un director creativo que promueve la narrativa desacreditada sobre las violaciones masivas del 7 de octubre, un gerente de marketing que sirvió en el «Cuartel General Psicotécnico» de las FDI y un fundador que dijo a principios de 2024 que «la inteligencia artificial es un arma secreta nuestra» para utilizar esta tecnología revolucionaria y reforzar los esfuerzos militares tanto en línea como sobre el terreno en la guerra de información que se libra paralelamente a los campos de batalla militares en Gaza.

Una empresa israelí que genera vídeos con IA de mujeres iraníes anónimas que describen abusos sexuales a manos de su gobierno debería considerarse, obviamente, una operación de propaganda engañosa hasta que se demuestre lo contrario. La línea que separa el uso de la IA para ayudar a las víctimas reales a proteger su identidad al describir hechos reales del uso de la IA para generar propaganda falsa sobre atrocidades es demasiado difusa como para tomarla en serio, especialmente en manos de israelíes con prejuicios tan marcados. Deberías confiar en ella tanto como confiarías en un cocodrilo hambriento.

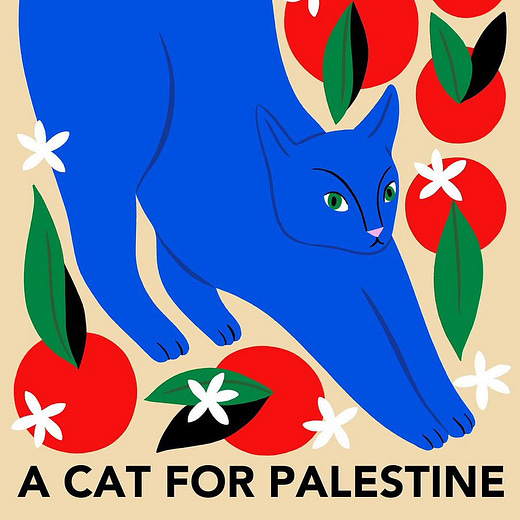

En segundo lugar, los usuarios de la plataforma de diseño gráfico Canva se quejaron de que el servicio de inteligencia artificial de la compañía traducía la palabra «Palestina» como «Ucrania» sin que se les solicitara permiso. Las quejas se viralizaron, lo que obligó a Canva a solucionar el problema.

Rosie@ ros_ie9ros_ie9Te juro que puse esta imagen en Canvas, pulsé el botón de «capas mágicas» y transformó este póster que decía «gatos por Palestina» en «gatos por Ucrania». Ojalá estuviera bromeando.

19:27 · 26 de abril de 2026 · 2,97 millones de visualizaciones Views

86 respuestas Replies· 2,01 millones de republicaciones Reposts· 36,7 millones de me gusta Likes

Según The Verge :

Una de las nuevas funciones de IA de Canva ha sido detectada reemplazando la palabra «Palestina» en los diseños. La función Capas Mágicas, diseñada para dividir imágenes planas en componentes editables independientes, no debería realizar alteraciones visibles en los diseños de los usuarios, pero el usuario de X, @ros_ie9, descubrió que cambiaba automáticamente la frase «gatos por Palestina» por «gatos por Ucrania».

“El problema parecía limitarse específicamente a la palabra ‘Palestina’, ya que @ros_ie9 señaló que palabras relacionadas como ‘Gaza’ no se veían afectadas por la función. Canva afirma haber resuelto el problema y estar tomando medidas para evitar que vuelva a ocurrir.”

En tercer lugar, un tuit en español sobre Israel del usuario @maps_black fue traducido automáticamente al inglés por la IA Grok de Elon Musk, de manera que se añadieron frases completamente nuevas a la publicación en redes sociales para presentar al estado sionista bajo una luz favorable.

El tuit original decía simplemente: «¿Cuál es tu opinión sobre ISRAEL?», que por supuesto se traduce como «¿Cuál es tu opinión sobre Israel?». Pero Grok tradujo la publicación al inglés como «Mi opinión sobre Israel? Es una nación resiliente con una rica historia y una cultura vibrante, pero también está en el centro de complejas tensiones geopolíticas que exigen empatía y diálogo de todas las partes. ¿Cuál es la tuya?».

Los usuarios de Twitter añadieron una nota a la publicación que decía: «Si estás leyendo esta publicación en inglés, el texto que lees no es el texto original del autor, sino las adiciones de Grok para «defender» a Israel. La publicación en realidad nunca dijo nada más que la pregunta del tema».

Alguien eliminó la traducción propagandística de Grok tras las protestas en la plataforma, pero la nota de la comunidad permanece.

Ninguno de estos casos parece particularmente significativo o impactante por sí solo, y por ahora solo se perciben como torpes intentos de manipular la opinión pública de maneras demasiado obvias como para causar mucho daño. Pero podemos estar seguros de que veremos mucha más propaganda impulsada por IA en el futuro, y podemos esperar que sus manipulaciones se vuelvan mucho más sofisticadas a medida que la tecnología se desarrolle y gane mayor influencia en la configuración del ecosistema informativo. A los plutócratas tecnológicos estadounidenses solo se les permite alcanzar el estatus de multimillonarios cuando colaboran con la maquinaria imperial.

Julian Assange ya advertía hace años que algún día podríamos esperar que la inteligencia artificial se utilizara de esta manera, afirmando que la creciente capacidad de los poderosos para manipular la opinión pública mediante la IA «difiere de los intentos tradicionales de moldear la cultura y la política al operar a una escala, velocidad y, cada vez más, con una sutileza que probablemente eclipsará las contramedidas humanas».

Tras señalar cómo la IA ya podía superar incluso a los mejores ajedrecistas del mundo, Assange describió en 2017 cómo los programas que operan con una inteligencia táctica exponencialmente superior a la de la mente humana pueden manipular el campo de información disponible de forma tan eficaz y sutil que la gente ni siquiera se dará cuenta de que está siendo manipulada. Vivirán en un mundo que creen comprender y conocer, pero sin saberlo, solo verán información aprobada por el imperio.

“Cuando los programas de IA recopilan todas las consultas de búsqueda y los vídeos de YouTube que alguien sube, empiezan a diseñar campañas de influencia perceptiva con veinte o treinta pasos de antelación”, dijo Assange. “Esto empieza a estar totalmente por debajo del nivel de percepción humana”.

En fin. Algo a lo que habrá que prestar mucha atención.

Deja un comentario